基于机器视觉无人平台自主导航避障系统简述_卓翼智能教学平台

随着人工智能概念的逐渐火热,对应的各种应用产业也逐渐发展起来,因为先天的优势,高校在人工智能教学方面肯定走在前列,对应人工智能大的行业,无人设备和机器视觉是其中非常重要的板块,为了更好的推进高校教学,围绕该板块,卓翼智能教学系统设计了一个平台方案。

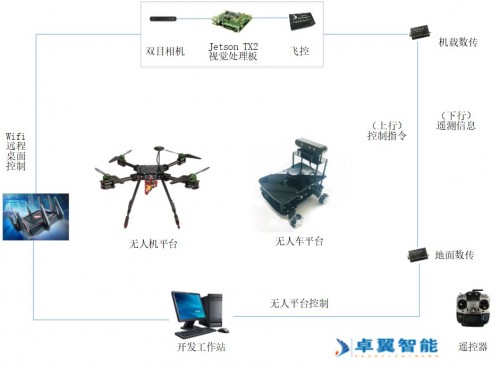

系统结合目前热门研究领域与研究方向,集无人机、无人车、双目视觉、机载AI视觉处理板卡于一体,形成全套的无人平台控制、通讯链路、视觉图像采集、图像识别、三维重建、定位解算等算法研究系统解决方案。为各科研团队、高校实验室提供硬件完善、功能齐全、开发环境完整、引领行业发展的全系统全功能开发测试环境,让各科研团队专注于slam导航避障算法研究。同时提供完整全套。

该系统提供全套的学科教学课程以及示例算法等,可快速展开相关课程设计,进行实际教学应用阶段。教科书级专业指导,永葆技术先进性。

卓翼智能教学整体方案

1、基于机器视觉无人平台自主导航避障系统组成架构

基于机器视觉无人平台自主导航避障系统硬件由:开发工作站、无人平台系统、机载双目视觉、机载图像处理板等组成。

开发工作站

开发工作站是系统开发实验控制平台,主要用于双目视觉目标识别训练系统开发使用,为前期视觉系统控制平台,当在上位机中控制成功后即可以移植到TX2上进行实时自主控制。

无人平台

无人平台为专为基于机器视觉无人平台自主导航避障系统研发的无人机或无人车平台,飞行控制稳定。可通过串口、USB接口、网络通讯等多种通讯控制接口控制。可搭载超声波、激光、光流GPS、RTK等诸多传感器,适应多种应用环境与系统组合。

机载双目视觉系统

机载双目视觉系统包括双目相机,实时采集无人机巡视拍摄信息,发送至TX2机载处理板卡进行避障、跟随以及slam计算,或下传至地面图传接收机由开发工作站进行处理。

2、基于机器视觉的无人车自主导航避障实验平台软件开发体系

基于机器视觉无人平台自主导航避障系统软件开发体系由视觉开发平台、信息交互与任务控制平台、无人机系统等组成。

卓翼智能教学可开设如下课程

双目视觉采集系统

通过立体匹配技术计算出二维图像的深度信息,同时利用视觉惯性融合技术估计相机自身的运动姿态,融合多帧深度信息,重建空间环境的体素地图。由地图获取障碍物距离信息,生成可执行路径。

视觉开发平台

由视觉开发训练环境Jetson TX2 视觉处理开发系统等组成、视觉定位平台、环境重建系统等组成。

信息交互与任务控制平台

由信息交互程序、避障与路径规划算法、无人机位置导航控制程序等组成。

系统软件运行架构如下图所示:

卓翼智能教学课程系统组成

1、硬件平台

基于机器视觉无人平台自主导航避障系统硬件由:开发工作站、无人平台系统、机载双目视觉、机载图像处理板等组成。

1)开发工作站

开发工作站是系统开发实验控制平台,主要用于双目视觉目标识别训练系统开发使用,为前期视觉系统控制平台,当在上位机中控制成功后即可以移植到TX2上进行实时自主控制。

2)无人平台

无人平台为专为基于机器视觉无人平台自主导航避障系统研发的无人机或无人车平台,飞行控制稳定。可通过串口、USB接口、网络通讯等多种通讯控制接口控制。可搭载超声波、激光、光流GPS、RTK等诸多传感器,适应多种应用环境与系统组合。

3)机载双目视觉系统

机载双目视觉系统包括双目相机,实时采集无人机巡视拍摄信息,发送至TX2机载处理板卡进行避障、跟随以及slam计算,或下传至地面图传接收机由开发工作站进行处理。

机载双目视觉系统所使用的双目视觉相机为小觅双目视觉相机。

采用小觅双目摄像头标准版,双目帧在硬件上同步。以60Hz的频率采集图像,分辨率达到752×480像素,如图2.2为小觅双目标准摄像头。内置六轴IMU传感器,频率可以达到500Hz。双目基线120mm。采用全局快门,可实现两个摄像头的所有像元同时曝光。在高速移动的拍摄场景中,能有效降低图像畸变,提供更加精准的图像源。

特点:

IMU 六轴传感器,IMU 与图像的同步精度高达0.05ms,为SLAM 算法以及空间移动算法的研发提供数据校正;

IR 主动光,2颗IR主动光探测器发射的红外结构光,有效增强白墙和玻璃等物体的识别精度,适用于完全黑暗环境;

自动白平衡,精准调教的感光元件和镜头提供室内外感光的自适应和调节;

双目帧同步,提供两颗摄像头的硬件级帧同步,减小因图像不同步而导致的误差;

全局快门,实现每个像元的同时曝光有效降低高速移动拍摄时的图像畸变;

灰度镜头,提供清晰的黑白视觉研究图像源,分辨率为752x480/60fps;

基线长度,120mm 的基线长度

免责声明:上文所示之内容和数据仅供参考,不构成投资建议,亦不代表本站观点。凤凰网港股虽竭力但亦不能保证以上内容之准确可靠,亦不会承担由此引起的任何损失或损害。